Falta una pieza clave en la declaración de la industria periodística sobre los “principios y leyes” necesarios para proteger la propiedad intelectual de los editores frente a la voracidad de la Inteligencia Artificial (IA), proclama que fue lanzada a comienzos de septiembre.

Esa pieza faltante es reafirmar en forma segura la autoría de contenidos digitales, y a la vez dejar un aviso a la IA para que no utilice esos contenidos para crear un nuevo producto, lo que efectivamente sería una competencia desleal.

De hecho, ya existe la tecnología necesaria para hacerlo y tiene mucho apoyo de la industria. Lo que falta es que sea adoptada por todos los actores claves del ecosistema digital. Hay muchos avances, pero aún faltan fichas claves para facilitar su adopción universal.

La tecnología, de fuente abierta, es impulsada por la Iniciativa de Autenticidad de Contenido (CAI por sus siglas en inglés), un esfuerzo colaborativo multisectorial que cuenta con más de 1,500 miembros incluyendo a centenares de casas editoriales, organizaciones de la sociedad civil y empresas de tecnología, IA y comunicación, entre otras.

Con la revolución digital, los contenidos salieron al mar abierto de las redes sociales y las plataformas, perdiendo los rastros de sus líneas genealógicas y de sus identidades, navegando sin rumbo en las aguas anónimas del mundo digital, sin dueño, ni documento de identidad.

Además, no tenían defensas. Fueron, y siguen siendo, cooptados y manipulados por terceros, usados fuera de contexto, tergiversando su sentido original. Navegaban junto a otros contenidos, desinformación maliciosa, o informaciones de calidad superficial, algo que instalaba duda sobre todo contenido.

Allí nació la necesidad de darle a la audiencia más certidumbre sobre el origen de los contenidos.

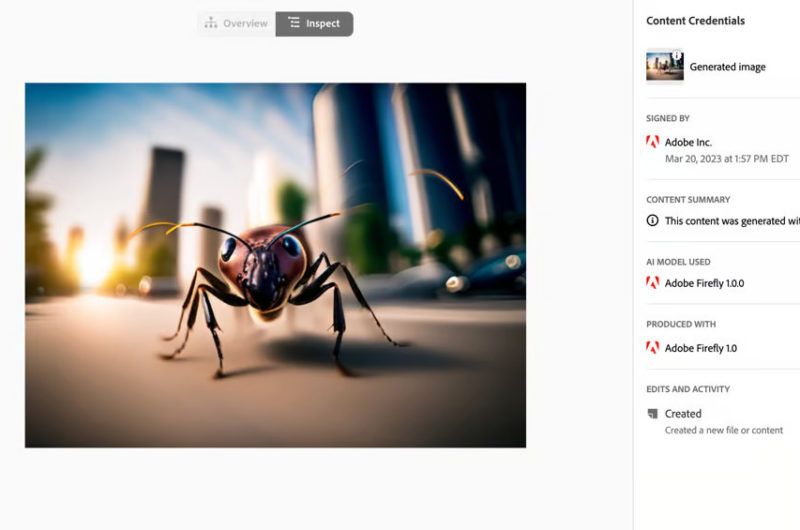

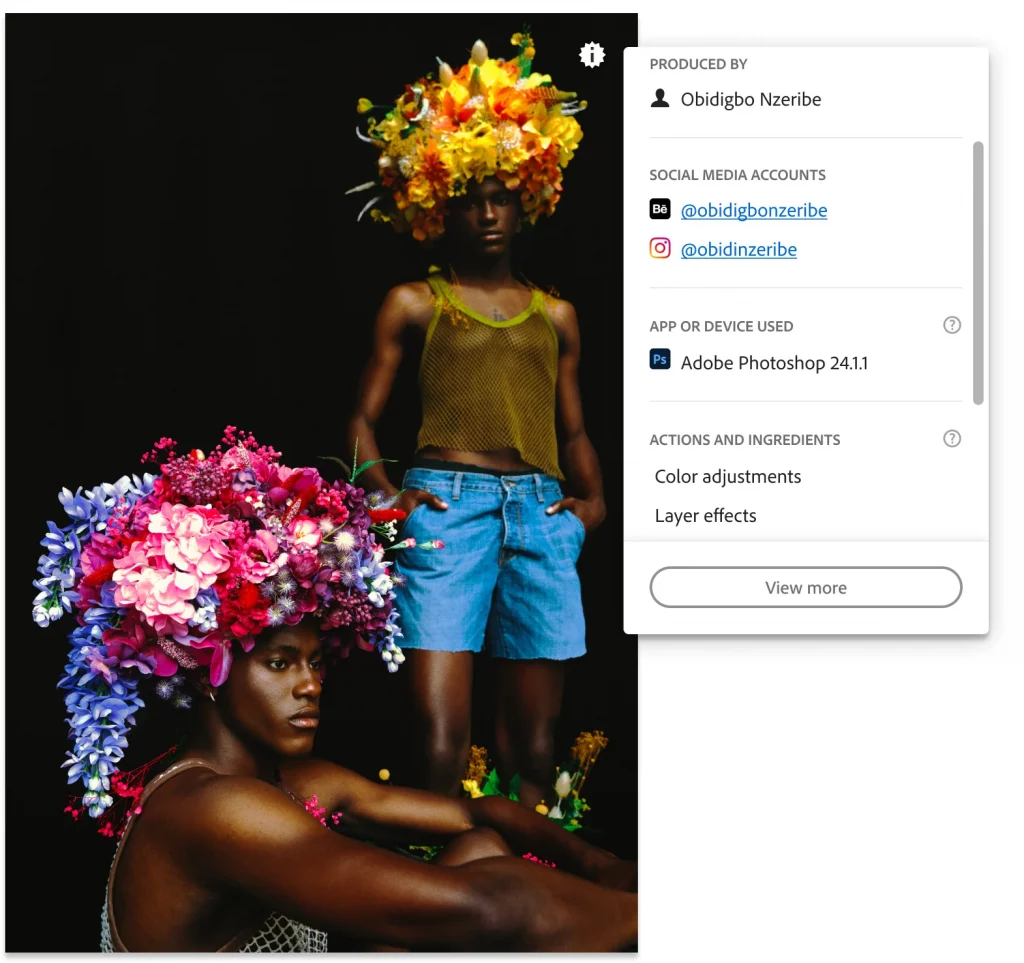

Trabajando con empresas de tecnología, la Coalición por la Procedencia y Autenticidad de Contenido (C2PA), el brazo tecnológico de CAI, desarrolló un estándar de procedencia de fuente abierta y encriptada. Usando la fotografía como ejemplo, el estándar guarda la información sobre dónde, cuándo y por quién fue sacada la foto, y luego registra todos los cambios realizados al archivo antes de su publicación.

En el momento de publicación, el público tiene la posibilidad de acceder a la información de procedencia mediante un enlace incrustado en la fotografía. Las credenciales del contenido, además, hacen dos cosas adicionales. Permiten a la casa editorial certificar la autoría del contenido al vincular el archivo con una cuenta de autoridad de verificación en su nombre y, a la vez, la opción de dejar un aviso en cada fotografía, texto, video o grabación para que el contenido no sea usado como modelo por la IA.

La postura de los medios de comunicación

La declaración: Principios Globales para la Inteligencia Artificial, fue dada a conocer en septiembre por un amplio grupo de asociaciones de prensa, tanto nacionales y regionales, como también internacionales. Entre los que apoyaron a la declaración figuran: WAN-IFRA, la Sociedad Interamericana de Prensa, la Associação Nacional de Jornais de Brasil, ADEPA de Argentina, AMI de Colombia, el Grupo de Diarios América, the News Media Alliance, News Media Canada, News Media Association y una variedad de asociaciones nacionales de Europa y Asía. Muchos son miembros de CAI.

El documento, aborda “los principios y leyes” a los cuales las empresas de IA deberían atenerse para evitar que los sistemas de IA se convierten en “graves amenazas para la sostenibilidad de las industrias creativas y para confianza del público en el conocimiento, el periodismo, la ciencia y la salud de nuestras democracias”.

“La apropiación indiscriminada de nuestra propiedad intelectual por parte de sistemas de IA no es ética, es perjudicial y constituye una infracción de nuestros derechos protegidos”, expreso el documento.

También propuso 12 puntos para lograr una implementación responsable y ética de la IA, incluyendo cuatro puntos sobre el respeto a la propiedad intelectual, y luego puntos sobre transparencia, rendición de cuentas, claridad e integridad, justicia, fiabilidad, privacidad, por diseño y desarrollo sostenible.

Si bien no son una solución mágica, las credenciales de contenido CAI podrían ser utilizadas para fortalecer en los hechos la aplicación de muchos de las leyes y principios propuestos. Para resumir, el estándar mundial de procedencia de CAI:

- Transparenta el origen de los contenidos, promoviendo la confianza de los consumidores. Entre otras cosas, permite poner una etiqueta junto al contenido para decir si fue creado por humanos o fue generado por IA, o si tiene elementos de IA.

- Establece un archivo inviolable, que puede ser asociado a una cuenta verificada de la empresa o autor, reafirmando en forma concreta su autoría.

- Protege a los contenidos contra la manipulación externa, cosa que podría causar daño a la marca y confundir al público. Detalla toda edición, o manipulación de contenidos humanos, en el proceso editorial, para dar certidumbre al público.

- Permite advertir a las empresas de Inteligencia Artificial en forma específica que uno no quiere que sus contenidos sean utilizados para entrenar a la misma.

- Ofrece una herramienta más para organizar y rastrear la utilización de los contenidos en el ecosistema digital.

No hay duda de que estas medidas prácticas son solamente parte de lo que hace falta. Sin un marco ético y legal, lo que recomienda el documento de la industria, perderían mucho de su potencial efectividad particularmente con relación a las cuestiones económicas y de propiedad.

Estos mismos temas han sido tratados en otros ámbitos. Uno de estos fueron las sesiones a mediados de julio del subcomité de propiedad intelectual del comité judicial del Senado de EEUU, “Inteligencia Artificial y Propiedad Intelectual – Parte II, Copyright”.

En la sesión del 12 de julio, Dana Rao, “Chief Trust Officer” de Adobe y fundador de CAI, afirmó que la tecnología de credenciales de contenido “será muy útil para abordar el problema del deepfake” pero insistió en que para que funcione debidamente primero debe ser adoptada por todas partes.

Las preocupaciones expresadas por las asociaciones de prensa son las mismas de muchas industrias. En la misma sesión del comité del Senado, Jeff Harleston, vicepresidente ejecutivo de Universal Music Group, otro socio de la iniciativa CAI, abordó estos temas.

“La IA al servicio de los artistas y la creatividad es algo maravilloso”, dijo Harleston en su testimonio. “Pero la IA que utiliza, o peor aún, se apropia de su trabajo -o de su nombre, imagen, imagen o voz- sin autorización, no lo es. Al establecer las reglas del juego de la Inteligencia Artificial, el uso de este principio rector puede ayudar a garantizar que nuestra clase creativa y las empresas que la apoyan sigan enriqueciendo nuestro mundo”.

Hay muchos avances hacía la implementación de las credenciales de contenido. Reuters y Canon completaron hace un mes una prueba de concepto del uso de las credenciales; Nikon y Leica se han comprometido a incluir la tecnología en próximas versiones de sus cámaras profesionales; Adobe Photoshop y el servicio de IA de Adobe – Firefly, usan credenciales de contenido y hay un par de soluciones para que los celulares tengan la opción de habilitar las credenciales.

Hace poco el International Press Telecommunications Council (IPTC), como parte de un esfuerzo para afianzar “Confianza y Credibilidad”, emitió lineamientos sobre como embeber metadatos de IPTC de manera verificable dentro de contenido protegido por el estándar C2PA de CAI.

Explicó que “la mayor parte de nuestro esfuerzo actual no consiste en detectar lo que es Fake, sino en permitir que los consumidores verifiquen que las noticias que ven proceden realmente de las mismísimas personas que ellos creen. Nos referimos a esto como «procedencia de confianza».

Por John Reichertz